シャドーAIが企業を脅かす見えないリスク!情報漏洩・著作権侵害を防ぐための対策を徹底解説

この記事のポイント

- シャドーAIとは企業が承認していないAIツールの業務利用で、情報漏洩リスクが急増中

- 機密情報の流出や著作権侵害など、企業の存続を脅かす重大なリスクが潜在

- 「禁止」ではなく「管理」が重要、ctc AI-Chatなど安全な環境構築で生産性向上と両立

ChatGPTやGeminiなど生成AIツールの登場により、専門知識がなくても誰もが手軽にAIを活用できる時代が到来しました。文章作成や翻訳、データ分析まで、かつては専門家に依頼していた作業が、今や誰でも手軽にできるようになりました。多くのビジネスパーソンが、日々の業務効率化にAIを活用し始めています。

しかし2023年4月、韓国のサムスン電子で発生した事案は、世界中の企業に衝撃を与えました。同社のエンジニアが業務効率化を目的にChatGPTに機密ソースコードを入力したところ、そのデータが外部に流出する事態に発展。純粋に「コードのエラーチェックを効率化したい」という動機からの行動でしたが、結果として企業の重要な知的財産が危険にさらされることとなったのです。

この事例が示すのは、従業員が悪意なく利用したAIツールが、企業の存続を脅かす重大なセキュリティリスクになりうるということ。企業側が把握・管理していない、従業員個人によるAI利用、いわゆる「シャドーAI」は多くの企業が直面する深刻な課題となっています。

本記事では、シャドーAIの実態と企業にもたらすリスクを明らかにするとともに、情報システム部門が今すぐ実践すべき具体的な対策について詳しく解説していきます。

シャドーAIとは?知らぬ間に広がる未承認AI利用の実態

「シャドーIT」という言葉は近年よく聞くかと思いますが、企業・組織が正式に承認していないAIサービスを、従業員が個人の判断で業務に利用することを「シャドーAI」と呼びます。

総務省の令和6年版「情報通信白書」によると、何らかの業務で生成AIを利用していると回答した企業の割合は、日本国内で55.2%に達しています。実に半数以上の企業で、すでに生成AIが業務の一部として活用されている状況です。しかし、この数字の裏側には、企業が把握していない「見えないAI利用」が潜んでいる可能性があります。

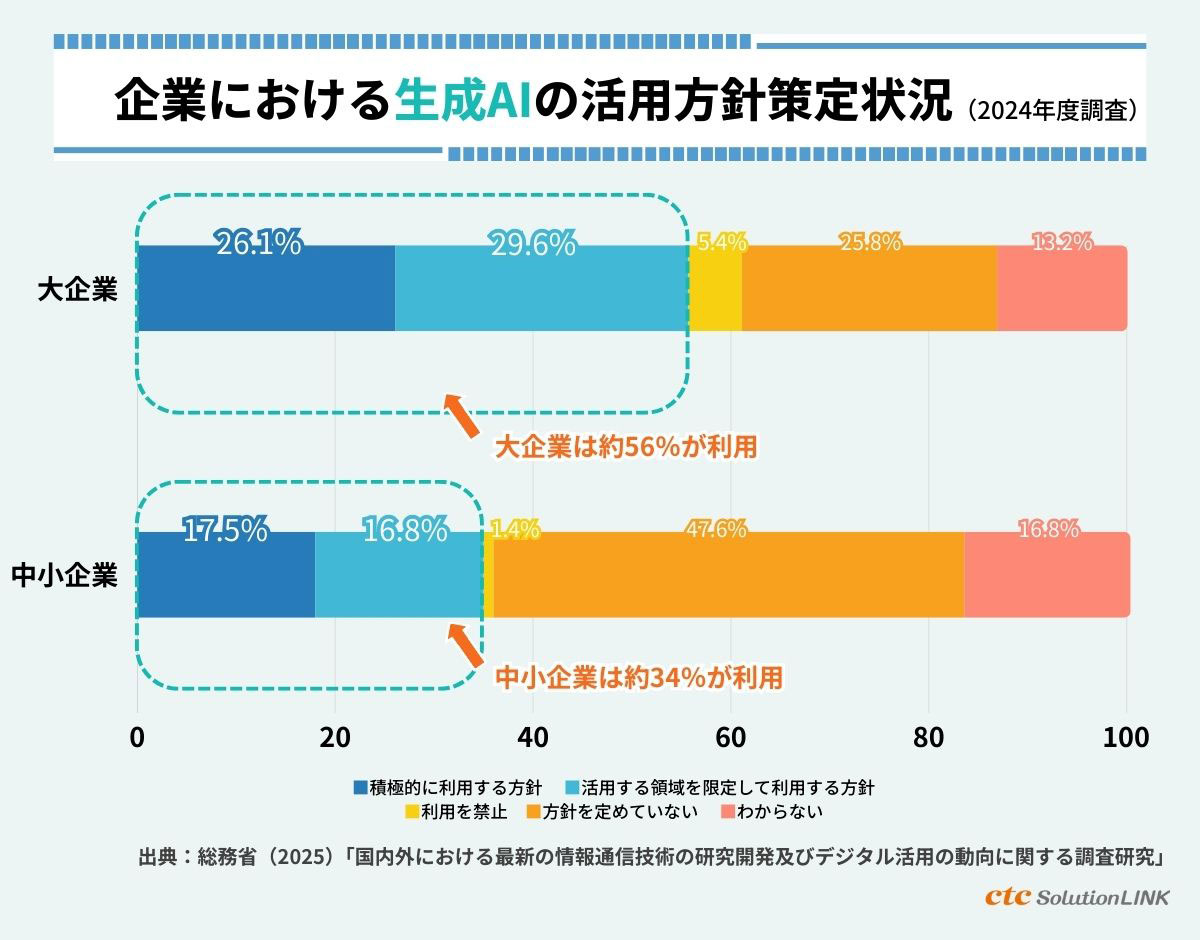

また、総務省の「令和7年版 情報通信白書」によると、生成AIの活用方針策定状況の調査では、中小企業では特に「方針を明確に定めていない」との回答が多く、大企業と比べると生成AIの活用方針の決定が進んでいない状況が分かります。

重要なのは、シャドーAIによるトラブルを引き起こしてしまう従業員には悪意がないという点。「長時間の会議の議事録作成を効率化したい」「膨大な資料の要約を素早く行いたい」「海外からの問い合わせメールを正確に翻訳したい」など、業務改善への純粋な動機から利用を開始するケースがほとんどです。

特に多拠点展開する企業では、状況はより複雑です。各支店や営業所、工場などの現場では、本社の承認を得ることなく、独自の判断でAIツールを導入するケースが後を絶ちません。「本社に申請すると時間がかかる」「現場のニーズをすぐに解決したい」といった理由から、各拠点が個別にAIサービスを契約・利用している実態があり、本社の情報システム部門がその全容を把握することは極めて困難となっています。

善意からの行動であっても、入力したデータがどこに保存されるのか、AIの学習に使われるのか、第三者に共有される可能性はないのか。こうしたリスクを理解せずに利用することで、取り返しのつかない事態を招く危険性があります。

では、実際にどのような行為がシャドーAIに該当するのでしょうか。以下、職場で起こりがちな具体的なシチュエーションを交えながら、シャドーAIの典型例を詳しく解説していきます。

あなたの職場でも起きているかも?シャドーAIの典型例

① 議事録作成の"時短術"に潜む罠

会議の内容を個人のスマートフォンで録音し、無料のAI文字起こしサービスで議事録を自動作成する。あるいは、顧客との商談内容をそのまま生成AIに入力して要約を作成し、社内で共有する。こうした行為は、業務効率化の観点から多くの職場で行われています。

しかし、機密性の高い経営会議の内容や顧客情報が、AIサービス提供企業のサーバーに保存される危険性があります。最悪の場合、競合他社がそのサービスを利用した際に、自社の機密情報が学習データとして反映されてしまう可能性も否定できません。

② メール・文書作成の"効率化"がもたらすリスク

取引先へのメール文面を生成AIに下書きさせ、そのまま送信する。提案書の構成を考える際に、顧客の要件や予算をそのまま入力してアイデア出しを行う。日々の業務で頻繁に行われているこれらの行為にも、重大なリスクが潜んでいます。

取引条件や顧客の機密情報が学習データとして利用され、他社のユーザーへの回答に含まれる可能性があるのです。ビジネス上の重要情報が意図せず流出してしまう危険性は、決して無視できません。

③ 翻訳・要約の"便利さ"に隠された脅威

海外取引先からの契約書や技術資料を、個人アカウントのAI翻訳サービスで日本語化する。膨大な市場調査レポートを生成AIに要約させて、経営判断の材料として使用する。グローバル化が進む現代のビジネスシーンでは、こうした使い方が日常的に行われています。

しかし、契約内容や競合分析データが外部に流出すれば、ビジネス上の優位性を失うリスクがあります。特に国際契約においては、機密保持条項に違反する可能性もあり、法的な問題に発展する恐れもあります。

④ データ分析の"スピード感"が招く情報漏洩

顧客リストや売上データをAIに分析させて、マーケティング戦略を立案する。従業員の人事評価データをAIサービスに入力して、傾向分析やレポート作成を行う。データドリブンな経営が求められる中、こうしたAI活用は魅力的に映ります。

しかし、これらの行為は個人情報保護法違反となる可能性があります。顧客の個人情報や、センシティブな人事情報が流出すれば、損害賠償請求や企業の信用失墜といった深刻な事態を招きかねません。

⑤ コンテンツ作成の"創造性"による著作権問題

社内プレゼンや提案資料の画像を、無料の画像生成AIで作成する。自社サービスの紹介文やキャッチコピーを生成AIで量産する。クリエイティブな作業の効率化として、多くの企業で導入が進んでいます。

しかし、生成物の著作権は非常に複雑で、意図せず他社の権利を侵害する可能性があります。特に商用利用において問題が発覚すれば、著作権侵害による法的措置や、ブランドイメージの毀損といった取り返しのつかない事態に発展する恐れがあるのです。

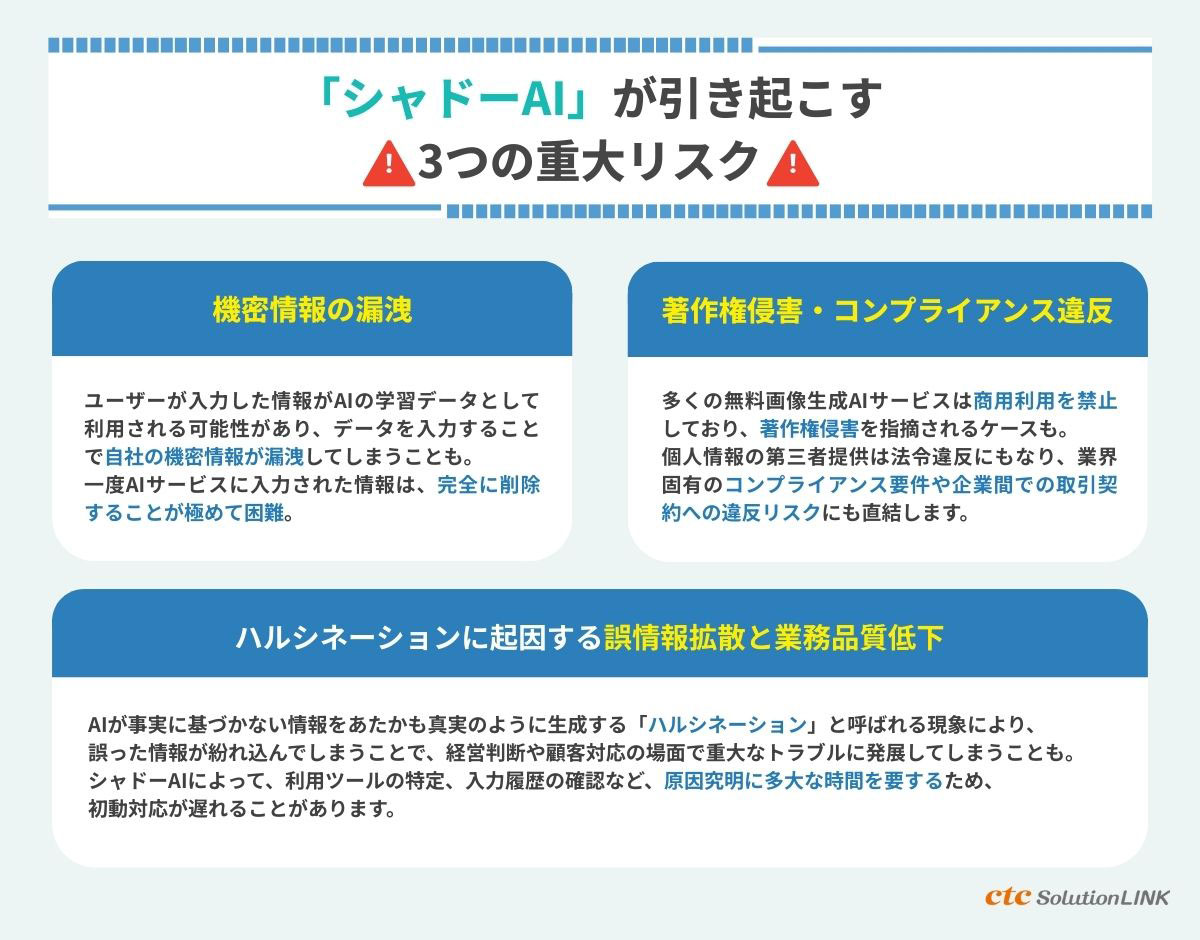

シャドーAIが引き起こす3つの重大リスク

シャドーAIは、表面的には業務効率化に大きく貢献しているように見えます。議事録作成時間の短縮、メール作成の効率化、データ分析の高速化など、従業員の生産性向上に寄与している側面は確かに存在します。

しかし、企業が正式に承認・管理していないAIサービスの利用は、その利便性の裏側で、企業の存続を脅かしかねない深刻な問題を引き起こす可能性があります。情報漏洩による競争力の喪失、法的リスクによる巨額の賠償責任、業務品質の低下による顧客離れなど、一度問題が発生すれば取り返しのつかない事態に発展する恐れがあるのです。

特に注意すべきは、これらのリスクが「見えない形で進行する」という点です。従業員は日々の業務で当たり前のようにAIサービスを使い続け、問題が表面化するまで誰もリスクに気づかない。そして、ひとたび問題が発覚すれば、企業は甚大な被害を被ることになります。

以下、シャドーAIがもたらす3つの重大リスクについて、実際に発生した事例や想定される被害シナリオを交えながら、詳しく解説していきます。

①機密情報の漏洩

シャドーAIがもたらす最も深刻なリスクが、機密情報の漏洩です。多くのAIサービスでは、ユーザーが入力した情報がAIの学習データとして利用される可能性があります。つまり、自社の機密情報を含むデータを入力すれば、それが他のユーザーへの回答に反映されるリスクが存在するのです。

漏洩リスクの対象となる情報の種類は、多岐にわたります。顧客の個人情報や購買履歴、自社の財務データや経営戦略、開発中の新製品の仕様や技術情報、取引先との契約条件や価格情報など、企業活動のあらゆる場面で扱われる機密情報が危険に晒されます。特に、競合他社も同じAIサービスを利用している可能性を考えると、自社の強みとなる情報が意図せず競合に渡ってしまうリスクは無視できません。

さらに深刻なのは、一度AIサービスに入力された情報は、完全に削除することが極めて困難だという点です。データがどのように保存され、どの程度の期間保持されるのか、削除要請にどこまで対応してもらえるのか。これらはサービス提供者の方針に依存し、企業側でコントロールすることはできません。つまり、一度の不注意な入力が、永続的な情報漏洩リスクを生み出してしまう可能性があります。

②著作権侵害・コンプライアンス違反

多くの無料画像生成AIサービスは商用利用を禁止しており、商用利用は有料プランで許可されることが一般的ですが、利用規約を詳細に確認せずに使用してしまうケースは少なくありません。その結果、商用利用禁止の画像を企業の広告キャンペーンや製品パッケージ、公式サイトなどに使用してしまい、後から著作権侵害を指摘される事例が増加しています。

法令違反のリスクも看過できません。個人情報保護法では、個人データの第三者提供に厳格なルールを定めていますが、顧客リストをAIサービスに入力する行為は、実質的に個人情報を第三者に提供することになります。不正競争防止法の観点からも、営業秘密に該当する情報をAIサービスに入力することは、秘密管理性を損なう行為として問題視される可能性があります。

業界固有のコンプライアンス要件への違反リスクも存在します。さらに、大手企業との取引契約では、情報管理に関する厳格な条項が含まれることが一般的。シャドーAIは、これらの要件や契約条項に違反する可能性が高く、発覚すれば取引停止という最悪の事態を招きかねません。

著作権侵害が認められた場合、企業は多額の損害賠償請求に直面します。また、侵害コンテンツの使用差止請求により、すでに制作した広告物や製品パッケージの回収・差し替えを余儀なくされ、莫大なコストが発生するケースも。コンプライアンス違反についても、行政処分や取引停止など企業活動に重大な支障をきたす事態に発展する恐れがあります。

最も深刻なのは、こうした問題が発生した際の企業の信用失墜。「適切な管理体制を構築していなかった」という管理責任を問われ、顧客や取引先からの信頼を一気に失うことになります。一度失った信用を回復するには、長い時間と多大な努力が必要となるのです。

③ハルシネーションに起因する誤情報拡散と業務品質低下

AIの回答は、必ずしも正確とは限りません。最も注意すべきは「ハルシネーション」と呼ばれる現象です。ハルシネーションとは、AIが事実に基づかない情報をあたかも真実のように生成する現象のことで、もっともらしい文章の中に誤った情報が紛れ込んでしまうのです。専門的な内容であればあるほど、その真偽を見極めることは困難になります。

この問題が経営判断に関わる場面で発生すれば、企業に甚大な損害をもたらします。例えば、市場規模や成長率といった重要な統計データをAIに問い合わせ、その誤った情報を基に新規事業への投資判断を行えば、巨額の損失につながりかねません。

顧客対応の場面でも、誤情報の拡散は深刻な問題となります。カスタマーサポートで生成AIを使って回答を作成し、誤った製品仕様や利用方法を案内してしまえば、顧客からのクレームは避けられません。特に、医療・金融・法律など、専門性の高い分野では、誤情報が顧客に実害をもたらす恐れもあります。

さらに厄介なのは、シャドーAIによる問題の原因究明が極めて困難だという点。企業が把握していないAIサービスの利用では、「誰が」「どのツールを」「どのように使ったか」を特定することができません。問題が発覚してから、各部署への聞き取り調査、利用ツールの特定、入力履歴の確認など、原因究明に多大な時間を要することになります。

この初動対応の遅れは、被害の拡大を招く致命的な要因となります。誤情報がさらに社内外に拡散し、二次被害、三次被害へと連鎖していく恐れがあります。また、顧客や取引先への説明責任を果たすにも、原因が特定できなければ適切な説明や再発防止策の提示ができません。「原因すら把握できない」という事実は、企業の信頼性を根底から揺るがすことになります。

情報漏洩・著作権侵害を引き起こす前に!実践すべき対策

シャドーAIには重大なリスクが潜んでいるにもかかわらず、なぜ企業内で急速に拡大しているのでしょうか。その背景には、AI技術の急速な普及と、企業側の対応の遅れという構造的な問題があります。

シャドーAIが起こってしまう原因

- 個人でも簡単に無料で利用開始でき、場所を選ばず利用できる

- AI利用に関する明確なルールやガイドラインが存在しない

- 入力したデータの扱いによるリスクを考慮せずに機密情報を入力

一方で、シャドーAIによるリスクは、適切な対策を講じることで大幅に軽減することが可能です。重要なのは、問題が表面化してから対応するのではなく、リスクが顕在化する前に先手を打つこと。組織的な取り組みと技術的な対策を組み合わせることで、AI活用のメリットを享受しながら、リスクを最小限に抑えることができるのです。

以下では、万が一シャドーAIによるインシデントが発生した場合の迅速な対処法と、そもそも問題を起こさないための予防策について、具体的かつ実践的な方法を解説していきます。

シャドーAIによるトラブルが起こってしまった場合の対処法

シャドーAIによる問題が発覚した際は、迅速かつ的確な初動対応が被害を最小限に抑える鍵となります。

情報漏洩が疑われる場合の初動対応

情報漏洩の可能性が発覚したら、まず該当AIサービスの利用を即座に停止し、全従業員に対して使用禁止を通達します。明確に禁止措置を取ることで、被害の拡大を防ぎます。

次に重要なのが証跡の保全。アクセスログ、入力履歴、生成履歴など、調査に必要となるあらゆるデータを速やかに保全します。時間の経過とともにログが上書きされたり、削除されたりする可能性があるため、発覚後すぐに行動することが肝要です。

並行して、漏洩した可能性のある情報の特定と影響範囲の調査を進めます。「誰が」「いつ」「どのような情報を」入力したのか、その情報が他のユーザーの回答に反映される可能性はあるのか、詳細な調査が必要です。特に個人情報が含まれる場合は、個人情報保護法に基づき、速やかに個人情報保護委員会への報告を検討する必要があります。

さらに、顧客や取引先への対応も欠かせません。情報漏洩の可能性がある段階でも、透明性を持って迅速に報告し、誠実な謝罪とともに今後の対応方針を説明します。初動の遅れや隠蔽は、後々さらなる信頼失墜を招くことになります。

著作権侵害が発覚した場合の対応

著作権侵害の疑いが生じた場合、まず該当コンテンツの使用を即座に中止します。ウェブサイトや広告など、すでに公開されているものについては、速やかに削除または差し替えを行います。

また、法務部門との連携は不可欠。担当者と協議し、適切な対応方針を決定します。AIによる生成物の著作権は特に複雑な領域であり、専門知識なしに判断することは危険です。

侵害の範囲と損害額の算定も重要な作業です。どの程度の期間、どの範囲で使用されたのか、それによる経済的利益はどの程度だったのかを明確にします。状況によっては外部の弁護士に相談し、法的リスクの評価と対応策の検討を行う必要があります。

最後に、再発防止策の策定は必須です。なぜ著作権侵害が発生したのか、どうすれば防げたのかを分析し、具体的な防止策を立案します。そして、その内容を全社に周知徹底し、同様の問題が二度と起こらないよう組織全体で意識改革を図ることが重要です。

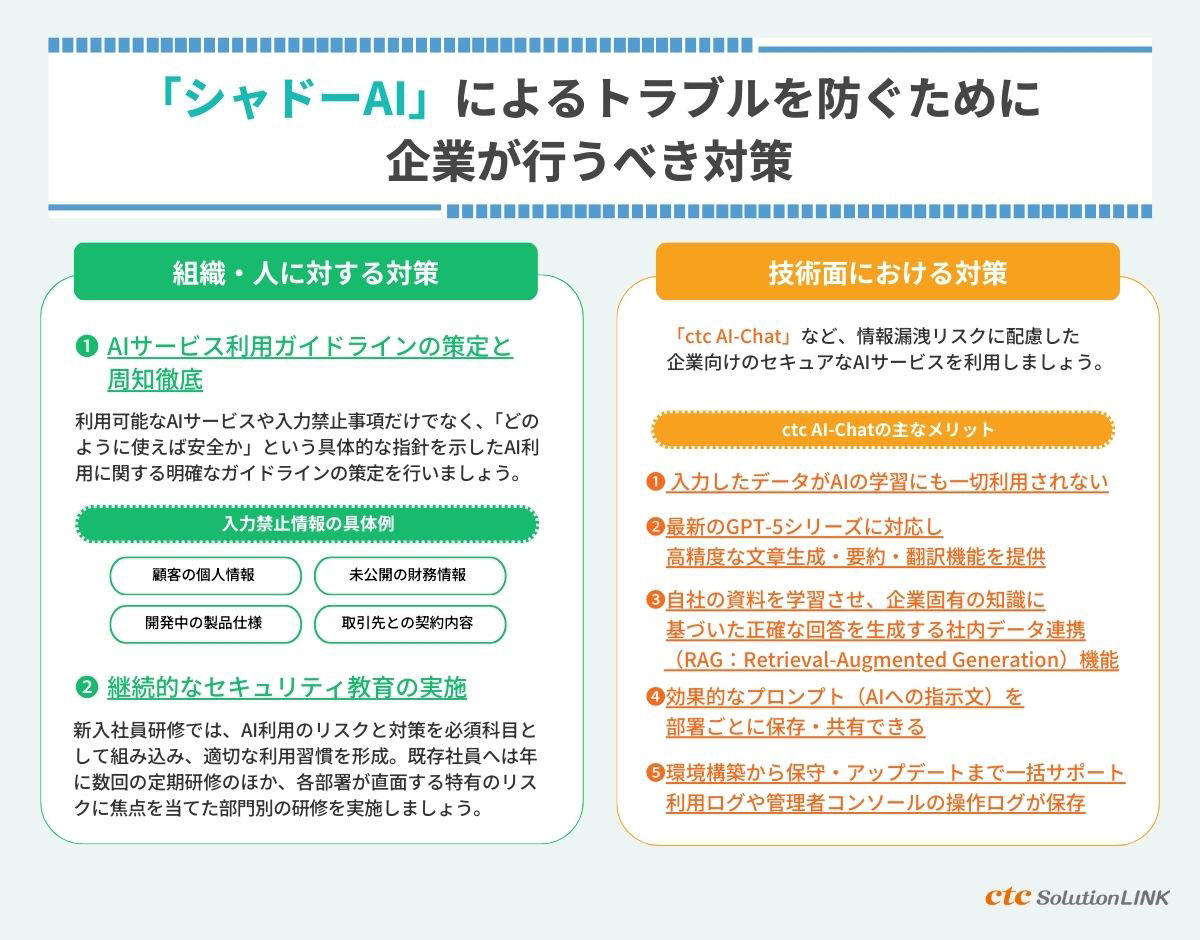

リスク対策①:組織・人に対するシャドーAI対策

シャドーAIによるトラブルを防ぐには、まず組織全体でAI利用に関する明確なルールを定め、従業員一人ひとりのリスク意識を高めることが不可欠です。技術的な対策だけでは限界があり、人的な側面からのアプローチが重要となります。

AIサービス利用ガイドラインの策定と周知徹底

企業として最初に取り組むべきは、AI利用に関する明確なガイドラインの策定です。禁止事項だけでなく、「どのように使えば安全か」という具体的な指針を示すことで、従業員が迷うことなく適切な判断ができるようになります。ガイドラインには、利用可能なAIサービスのリストを明記。企業が安全性を確認し、正式に承認したツールのみを使用可能とすることで、未承認ツールの利用を防ぎます。また、承認済みツールであっても、入力してはいけない情報を具体的に列挙することが重要です。

【入力禁止情報の具体例】

- 顧客の個人情報(氏名、住所、電話番号、メールアドレス、購買履歴など)

- 未公開の財務情報(売上データ、利益率、投資計画、M&A情報など)

- 開発中の製品仕様(設計図、ソースコード、特許出願前の技術情報など)

- 取引先との契約内容(価格情報、取引条件、機密保持契約で保護された情報など)

生成物の利用についても、明確なルールが必要です。AI生成コンテンツを業務で使用する際の著作権確認方法、商用利用の可否を判断する基準、社内承認が必要なケースなどを定めます。特に、対外的に公開される資料や広告物については、必ず法務部門のチェックを経るプロセスを組み込むべきです。

継続的なセキュリティ教育の実施

ガイドラインを策定しても、それが形骸化しては意味がありません。継続的な教育により、従業員のセキュリティ意識を高め続けることが重要。新入社員研修では、AI利用のリスクと対策を必須科目として組み込みます。入社時点で正しい知識を身につけることで、最初から適切な利用習慣を形成できます。実際の被害事例を交えながら、「なぜ危険なのか」を理解してもらうことが、ルール遵守への動機づけとなります。

既存社員に対しては、年に数回の定期研修を実施します。AI技術は日々進化し、新たな脅威も次々と登場するため、最新の動向を共有することが不可欠です。他社で発生した事故事例を教材として、「自社でも起こりうる」という危機感を持ってもらうことが効果的です。

さらに効果的なのが、部門別の研修です。営業部門では顧客情報の取り扱い、開発部門ではソースコードや技術情報の保護、人事部門では従業員の個人情報管理など、各部署が直面する特有のリスクに焦点を当てた教育を行います。自分の業務に直結する内容であれば、従業員の関心も高まり、実践的な対策につながります。

こうした組織的な取り組みにより、シャドーAIは「個人の問題」ではなく「組織全体で取り組むべき課題」という認識が醸成され、リスクの大幅な軽減が期待できます。

リスク対策②:技術面におけるシャドーAI対策

従業員に使用を禁止するだけでは、業務効率化のニーズは満たされず、結果的にシャドーAIの利用を助長してしまいます。そこで必要となるのが、セキュリティが担保された安全な生成AI環境の提供です。

安全な生成AI環境の構築「ctc AI-Chat」

ctcが提供する「ctc AI-Chat」は、Microsoft Azure OpenAI Serviceを基盤とした、企業向けのセキュアなAIサービスです。最大の特徴は、入力したデータが外部に流出せず、AIの学習にも一切利用されないという安心設計。企業の機密情報を守りながら、生成AIの利便性を最大限に活用できる環境を実現しています。最新のGPT-5シリーズに対応し、ChatGPT Plusと同等以上の高精度な文章生成・要約・翻訳機能を提供。セキュリティの心配なく思い切って活用できることで、生産性のさらなる向上が期待できます。

また、Web検索機能により最新情報を取得できるため、常に最新のデータに基づいた回答が可能。画像認識機能では、グラフや図表の内容を理解し、それに基づいた分析や要約を行えます。さらに作図機能により、複雑な業務フローやシステム構成図なども、テキストの指示だけで作成可能です。

特筆すべきは、社内データ連携(RAG:Retrieval-Augmented Generation)機能。自社のマニュアル、規程、過去の提案書などを学習データとして活用することで、企業固有の知識に基づいた正確な回答を生成します。プロンプト保存機能も、組織的な活用を促進する重要な機能です。効果的なプロンプト(AIへの指示文)を部署ごとに保存・共有することで、ベストプラクティスを組織全体で活用。新入社員でも、先輩が作成した優れたプロンプトを使って、すぐに高品質なアウトプットを生成できます。

運用面でも万全のサポート体制を整えています。環境構築から保守・アップデートまで、ctcが一括してサポート。企業側でAIの専門知識を持つ必要はなく、安心して利用に専念できます。また、利用ログや管理者コンソールの操作ログが保存されるため、誰がいつ、どのような用途で利用したかを把握可能。万が一の問題発生時にも、迅速な原因究明と対策が可能です。

このように、ctc AI-Chatは単なる「安全なAIサービス」ではなく、企業のAI活用を総合的に支援するプラットフォームとして機能します。シャドーAIのリスクを排除しながら、メリットを最大限に引き出すことで、真の意味でのDX推進を実現できます。

情報漏洩リスクに配慮した安心安全な生成AI│ctc AI-Chat

最新のAIモデルを採用した多機能な生成AIサービス。入力したデータがAIの学習に活用されない専用環境で、安心安全に業務効率化に活用できます。

ctcとともに実現する安全で革新的なAI活用

生成AIの業務利用が急速に広がる中、シャドーAIによる情報漏洩や著作権侵害のリスクは日々高まっています。規模や業種を問わず、あらゆる企業がAI利用に関するルールの整備に早急に取り組むべき時期に来ています。

重要なのは、AIサービスの利用を「禁止」することではありません。必要なのは適切な管理体制の構築と、従業員への正しい利用方法の教育によるリスクコントロールです。AIと上手に付き合いながら、そのメリットを最大限に引き出すことがこれからの企業には求められています。

対策の第一歩は、自社のAI利用実態を正確に把握すること。どの部署で、どのようなAIサービスが使われているのか。まずは現状を可視化し、その上で利用ルールの策定、セキュリティ研修の実施、そして安全なAI環境の構築へと段階的に進めていくことが重要です。

ctcは、こうした企業のAI活用を全面的にサポートします。セキュアな生成AI環境「ctc AI-Chat」の提供はもちろん、導入前のコンサルティングから導入支援、さらには導入後の活用促進まで、AI活用に関するあらゆるフェーズをワンストップで支援。お客さまが安心してAIを活用できる環境づくりをお手伝いします。Microsoft Azure基盤の堅牢なセキュリティと、通信事業者として長年培ってきた信頼性。この2つを兼ね備えたctcだからこそ、真に安全なAI活用環境を提供できます。

「シャドーAIのリスクが心配だが、どこから手をつければよいかわからない」「安全に生成AIを活用したいが、自社に合った方法がわからない」「限られた予算の中で、段階的な導入を検討したい」「自社の業界特有の規制やガイドラインに対応したAI活用を実現したい」

こうした生成AIの活用に関するお悩みをお持ちの企業は、ぜひctcまでお気軽にご相談ください。経験豊富な専門スタッフが、お客さまの現状と課題を丁寧にヒアリングし、サポートいたします。

▼出典