人手不足問題を解消する「生成AI」を安全に使うには?「シャドーAI」による業務リスクを理解して業務効率化へ

このマンガのポイント

- 人手不足が叫ばれる企業では、生成AI活用による業務効率化がカギに

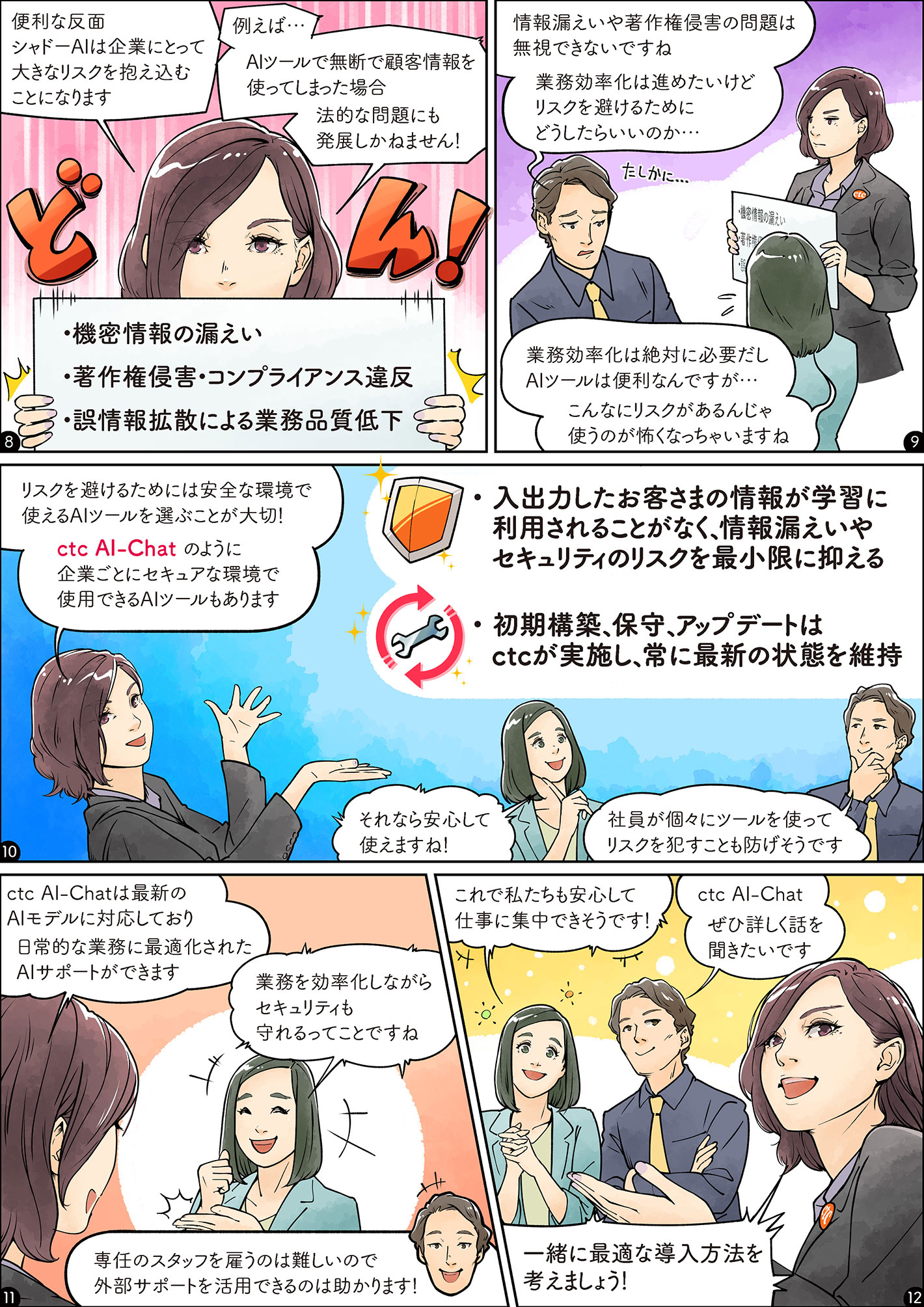

- 一方で「シャドーAI」による情報漏えいや法令違反などのリスクも

- 社内ルールのITリテラシー向上や安全なツールの導入が不可欠

多くの企業では、生成AIを活用した業務効率化に関心があるものの、具体的な導入や活用には至っていないケースが少なくありません。とくにリソースが限られている中小企業ほど、今後、生成AIの活用は業務効率化や競争力維持のためにますます重要になっていくでしょう。

しかし、生成AIの利便性の裏側には、企業にとって無視できないリスクが潜んでいます。従業員が個人の判断で未承認のAIサービスを利用することを「シャドーAI」と呼びます。

これにより、意図せず機密情報漏えいやコンプライアンス違反を招き、企業に甚大な損失をもたらす危険性があるのです。

本記事では、シャドーAIとは具体的にどのような事例を指すのか、どのようなリスクがあるのかを解説し、企業が生成AIの恩恵を安全に享受するための具体的な対策についてご提案します。

人手不足の企業にこそ生成AIの活用が求められる

多くの企業が直面する深刻な課題として、日本の構造的な問題でもある「人手不足」と、それに伴う「生産性の低迷」が挙げられます。少子高齢化による労働力人口の減少は今後さらに加速し、採用競争はますます激化していくことが予想されます。こうした状況下で、限られた経営資源の中、従業員一人ひとりの業務負担は増加の一途をたどっています。

日々の業務に追われるあまり、業務改善やスキルアップに時間を割けないといった環境下で働く方も多いでしょう。目の前の課題への対応に終始し、企業の成長に必要な生産性向上への取り組みが後回しに。結果として効率化が進まず、さらなる業務負担の増加という悪循環に陥ってしまいます。

こうした状況を打破する可能性を秘めているのが、生成AIの活用です。従来の大規模なシステム開発とは大きく異なり、現在では手軽に導入できる生成AIツールが数多く存在しています。月額数千円程度、あるいは無料で利用を開始でき、特別なIT知識も必要ありません。文書作成、データ分析、顧客対応といった日常業務をAIに任せることで、従業員はより付加価値の高いコア業務に集中できるメリットがあります。

しかし、その便利さの裏には見過ごせないリスクも潜んでいます。最も深刻なのが、情報漏えいの危険性。「入力したデータがどのように扱われるか」を十分に理解せずに生成AIを利用すると、機密情報や個人情報が意図せず外部に流出してしまう恐れがあります。入力された情報がAIモデルの学習に利用されたり、別のユーザーへの回答の中に組み込まれたりしてしまう可能性も指摘されています。

こうしたリスクを適切に理解しながらAIツールを活用していく必要がありますが、現実的には「誰が」「いつ」「どの」ツールを使っているかが見える化できていない企業がほとんど。社員それぞれが個別に様々なAIサービスを利用している状況では、どれだけセキュリティ対策を講じても、リスクを完全に防ぎきることはできません。組織全体でのガバナンス体制の構築が、生成AI活用における重要な課題となっているのです。

シャドーAIとは?

「シャドーAI」とは、企業が正式に承認していないAIサービスを、従業員が個人の判断で業務に利用することを指します。この問題の根深さは、シャドーAIによるトラブルを引き起こしてしまう従業員に悪意がないという点にあります。その多くは「業務を効率化したい」「より良い成果を出したい」といった業務改善への純粋な動機から利用を開始しており、情報漏えいや著作権侵害といった深刻なリスクを十分に理解しないまま、手軽で便利なAIツールに手を伸ばしてしまうのです。

「少しでも早く資料を完成させたい」「質の高い提案書を作りたい」という前向きな気持ちが、結果的に企業全体を危険にさらしてしまう。これがシャドーAIの最も厄介な点といえるでしょう。

主なシャドーAIによる危険な活用例

- 顧客との商談内容をそのまま生成AIに入力して要約を作成

- 取引先へのメール文面作成

- 顧客の要件や予算をそのまま入力してアイデア出しを行う

- 膨大な市場調査レポートを生成AIに要約させて、経営判断の材料として使用

- 顧客リストや売上データをAIに分析させて、マーケティング戦略を立案

- 商用利用の画像を、無料の画像生成AIで作成

これらの事例に共通するのは、従業員が「便利だから」「効率的だから」という理由で、企業の重要な情報を外部のAIサービスに委ねてしまっている点。一見すると業務改善に見える行為が、実は企業の存続を脅かすリスクを内包していることを認識できていないことが、トラブルにつながる原因なのです。

シャドーAIが引き起こす深刻なリスク

利便性の裏側で、企業の存続を脅かす深刻な問題を引き起こすのが「シャドーAI」の恐ろしさです。この問題は「見えない形で進行」し、重大な損失が発生するまで気付かれないことが多く、発覚した時には既に手遅れという状況に陥りがちです。

具体的なリスクの事例

-

機密情報の漏えい

最も深刻なリスクが、機密情報の漏えいです。多くの生成AIサービスでは、入力された情報がAIの学習データとして利用され、他のユーザーへの回答に反映される仕組みになっています。これにより、顧客の個人情報や購買履歴、財務データや経営戦略、開発中の製品仕様や技術情報、取引先との契約条件や価格設定など、企業活動のあらゆる場面で扱われる機密情報が意図せず外部に流出してしまう危険性があります。

さらに深刻なのは、一度入力した情報の完全な削除が困難であることです。情報の取り扱いはサービス提供者の方針に依存し、企業側でコントロールすることができません。つまり、一度の不注意な入力が、永続的な情報漏えいリスクを生み出してしまう可能性があるのです。業務効率化のつもりが、企業の競争優位性を永続的に損なう結果を招くという、取り返しのつかない事態を招きかねません。 -

著作権侵害・コンプライアンス違反

法的リスクも見過ごせません。商用利用が禁止されている画像を生成AIで作成し、広告やパッケージデザインに使用した結果、著作権侵害を指摘される事例が増加しています。また、顧客リストをAIサービスに入力することで、個人情報保護法違反や不正競争防止法における秘密管理性の喪失を招く恐れもあります。

こうした違反が発覚した場合、損害賠償請求はもちろん、広告物や製品パッケージの回収・差し替えといった多額のコストが発生します。さらに深刻なのは、管理責任を問われることで、長年築き上げてきた顧客や取引先からの信頼を一気に失ってしまうことです。「コスト削減のつもりが、想定を遥かに超える損失を生む」という皮肉な結果を招いてしまうのです。 -

誤情報拡散による業務品質低下

AIが事実に基づかない情報をあたかも真実のように生成する現象(ハルシネーション)により、業務判断や顧客対応に重大な誤りが生じるリスクも存在します。誤った情報が顧客に伝わることで、信頼失墜やクレームにつながる事例も報告されています。

とくに問題となるのは、「誰が」「どのツールを」「どのように使ったか」を企業が把握していない場合、問題発生源の特定が困難になること。問題発覚後の調査に時間を要している間に誤情報が社内外に拡散し続け、二次・三次被害へと連鎖する恐れがあります。小さなミスが、企業全体の信用を根底から揺るがす大問題へと発展する。これがシャドーAIの持つ最も恐ろしい側面といえるでしょう。

情報漏えい・著作権侵害・誤情報拡散を引き起こす前に

AI利用に関する明確なルール策定と周知が、シャドーAI対策の第一歩となります。社内におけるAI利用に関する明確なガイドラインの策定を早急に行い、全従業員に周知徹底することが不可欠です。このガイドラインには、利用可能なAIサービスの一覧、入力禁止情報の具体例、生成物の利用ルールを詳細に明記する必要があります。

重要なのは、単に禁止事項を羅列するだけではなく、「どのように使えば安全か」という具体的な指針を示すことです。たとえば「顧客情報は入力しない」という抽象的な表現ではなく具体的な基準を設けることで、従業員が迷うことなく適切な判断を下せるようになります。

ルールを策定するだけではなく、継続的な教育による従業員の意識向上も欠かせません。まず、新入社員研修においてAI利用のリスクと対策を必須項目として組み込み、入社時点から正しい認識を持たせることが重要です。「リスクを理解して適切に活用する」という意識を根付かせる必要があります。

また、年に数回の定期研修を実施し、最新のリスクや注意点を継続的に周知しましょう。AI技術は日進月歩で進化しており、新たなサービスやリスクが次々と登場しています。「半年前の知識では対応できない」という状況が頻繁に発生するため、常に最新情報をアップデートし続ける体制が必要です。さらに効果的なのは、各部門が直面する特有のリスクに焦点を当てた教育。営業部門では顧客情報の取り扱い、開発部門では技術情報の機密性、人事部門では個人情報保護といった部門ごとに異なるリスクポイントを具体的に説明することで、より実践的な理解を促進できます。

最も重要なのは、セキュリティが担保された安全な生成AI環境を企業として提供することです。AI使用を一律に禁止するだけでは、かえってシャドーAIの利用を助長してしまう結果を招きます。「公式には使えないが、業務上必要だから隠れて使う」という状況が生まれ、問題はより深刻化してしまうのです。

企業管理下で安全にAIを活用できる環境を整備することで、従業員の生産性向上とリスク管理を両立させることが可能になります。入力データの暗号化、学習データへの利用禁止、ログ管理機能などを備えた企業向けAIサービスを導入し、「安全に使える環境があるからこそ、危険な外部サービスは使わない」という好循環を生み出すことが、真の解決策といえるでしょう。

ctc AI-Chatの特長

- Microsoft Azure OpenAI Serviceを基盤とした企業向けセキュアAIサービス

- 入力データは外部に流出せず、AIの学習にも一切利用されない安心設計

- 性能・レスポンスの優れた最新AIモデルに対応し、高精度な文章生成・要約・翻訳機能で業務効率化を実現

- 環境構築から保守・アップデートまでctcが一括サポート。AI専門知識は不要

- 利用ログや管理者コンソールの操作ログが保存され、万が一の際にも迅速な原因究明と対策が可能

生成AIを使うならリスク管理をして安心安全な環境で

生成AIは企業の業務効率化において、もはや不可欠なツールとなってきています。しかし、シャドーAIによるトラブルのリスクを十分に理解せずに利用することは、企業に大きな損失を生み出す原因にもなり得ます。

一方で、人手不足が深刻化する昨今の状況を考えると、日々の業務負荷軽減のためにもAIツールの導入による効率アップは重要な課題。「リスクがあるから使わない」という選択肢は、現実的とはいえません。大切なのは、リスクを適切に管理しながら、生成AIの恩恵を最大限に活用する方法を見つけることです。

まず取り組むべきは、生成AIの利用に関する明確なガイドラインの策定と、従業員への注意喚起。何が危険で何が安全なのか、どのような情報は入力すべきでないのか、生成された内容をどう扱うべきなのか。こうした基本的なルールを明文化し、全社員で共有することから始めましょう。正しい知識を共有することが、企業を守る重要な第一歩となります。

その上で、安心安全な環境で生成AIの便利な機能を利用できる、「ctc AI-Chat」のようなツールの導入を検討されることをおすすめします。ctcでは、導入前の検討段階から運用定着まで、ワンストップでサポート。単にツールを提供するだけでなく、企業の業務フローに合わせた最適な活用方法の提案から、従業員への教育・研修、運用後の継続的なサポートまで包括的にお手伝いします。

生成AIは、決してサービスそのものに危険性があるわけではありません。正しく仕組みやリスクを理解し、従業員の効率アップや企業全体の持続的な成長を目指しながら、効果的に活用していきましょう。